“谁是我们的敌人?谁是我们的朋友?这个问题是革命的首要问题。”

反思

做为一个写了很多文章,一直在鼓吹 AR 的AR 神棍,我对 AR 的兴趣开始于 2015 年,那时刚入门 iOS 开发一年左右,正是 AR/VR 又一次火起来的时候,当时苹果也还没有拿出 ARKit,只好先学开发基础知识和 SceneKit。

从 ARKit 推出后,我就利用业余时间不停学习这个框架,并尝试写一些 Demo 和基础文章,学习相关数学基础,整整三年从 ARKit 1 跟着学到了 ARKit 3。

在这四五年里,看到了 AR/VR 行业经历了一个完整的泡沫周期:概念普及 --> 引人瞩目 --> 期望过高骗子横行 --> 热情下降 --> 无人问津。

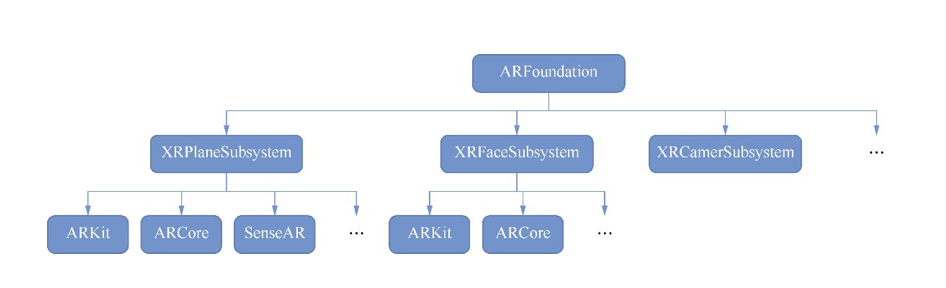

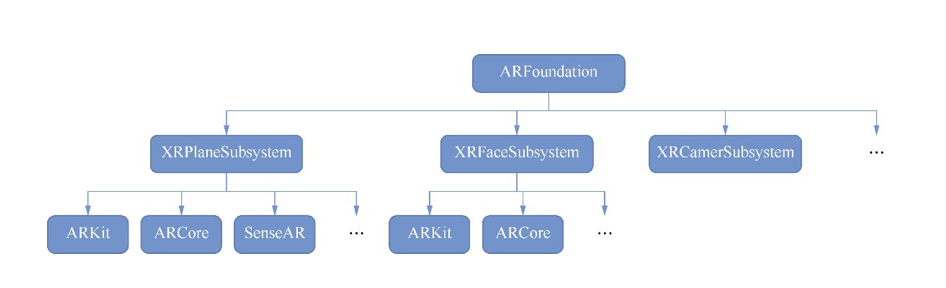

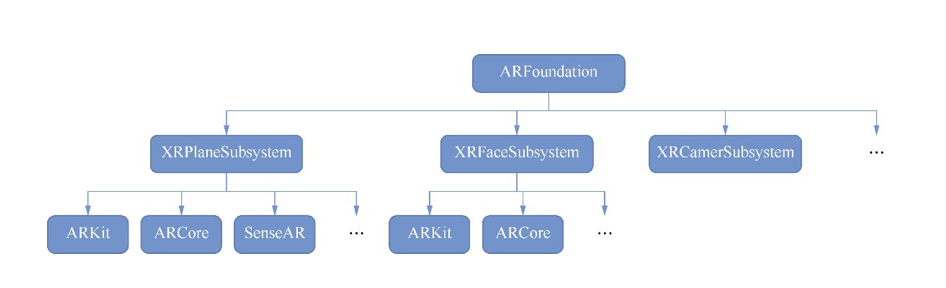

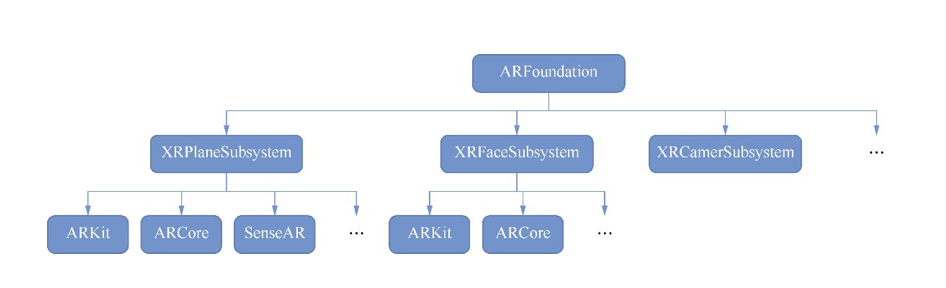

到 2020 年中,虽然 AR 仍然没有火起来,但我已经在移动 AR 行业完整工作一年了,开发了 10 多个大大小小的 Demo 和几个完整的 AR 产品,对 iOS 平台的 ARKit 比较熟悉,对苹果新推出的 RealityKit 及 Unity 平台的 ARFoundation 也有一定了解。

但是,即使我在 AR 方面付出了这么多努力,有了不少经验,我却从没有认真深入思考过革命的首要问题:AR 到底需要学什么?用 AR 又该做什么?

AR 基本流程

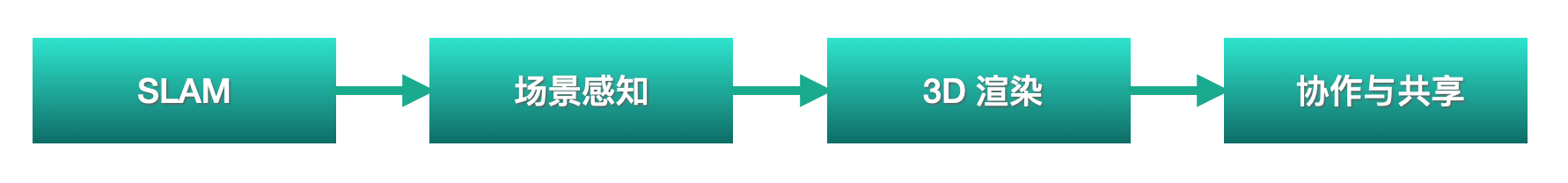

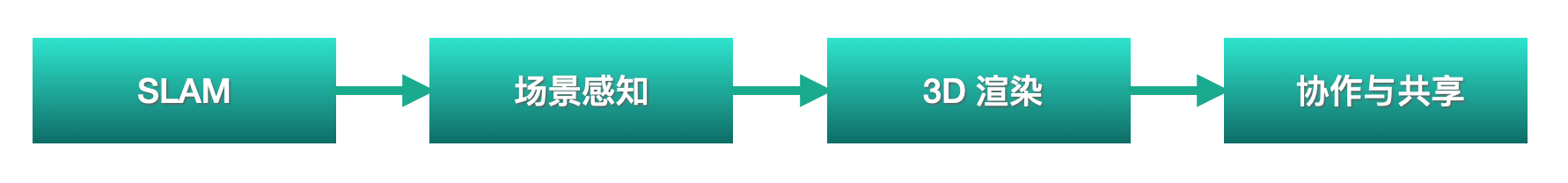

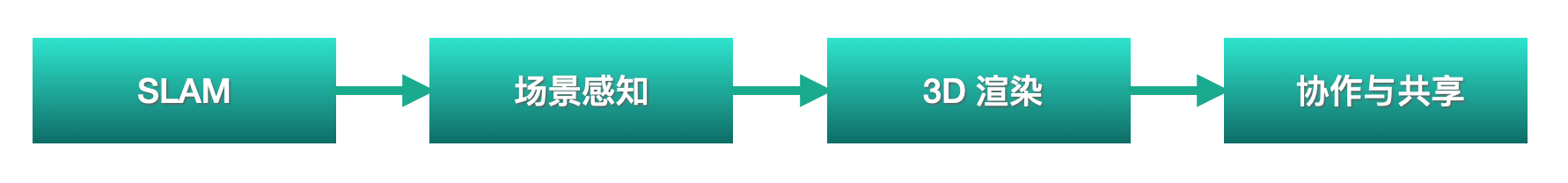

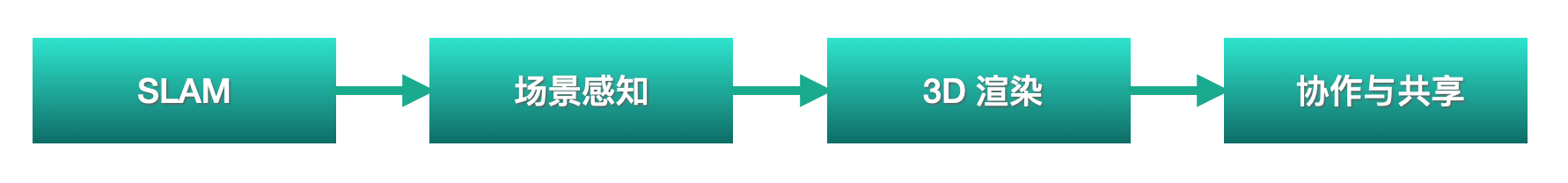

要搞明白这些问题,就必须先来梳理一下 AR 的基本流程:

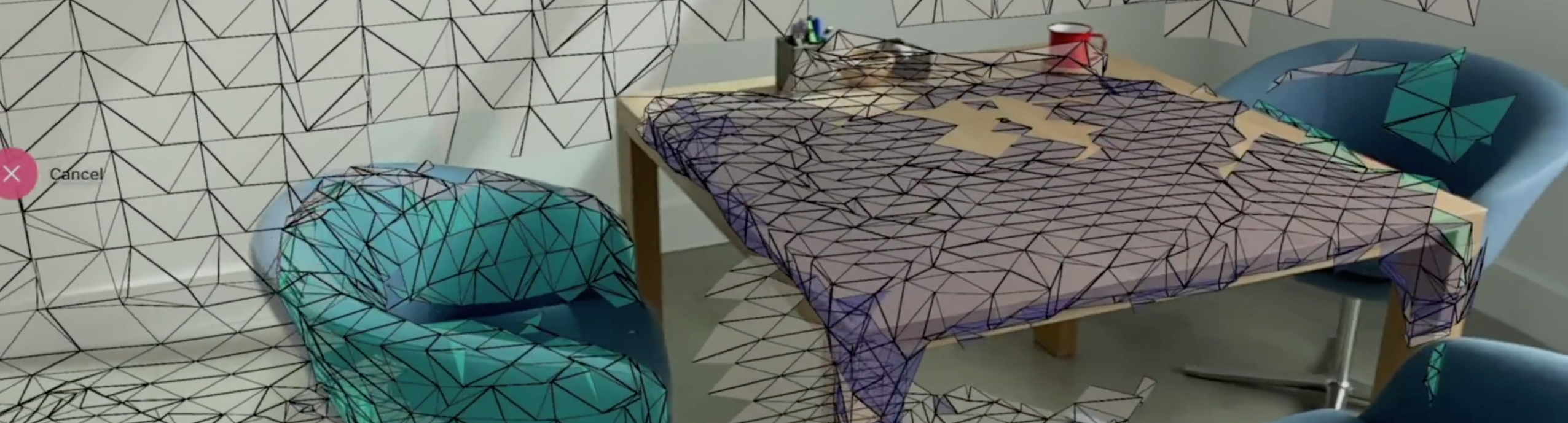

- 即时定位与地图映射(SimultaneousLocalizationAndMapping,SLAM):依靠 VIO+IMU+CV+TOF 等技术,实现特征点提取,场景重建,平面识别,图片识别等功能;

- 场景感知和识别:依靠 CV 、ML 等技术,识别不同场景和其中的物体,比如 ARKit 已经能够识别桌子、椅子、墙面、天花板、人体等;

- 叠加 3D 图像和声音:依靠 3D 渲染技术,将虚拟的画面和声音,叠加在的场景中或者已识别的物体上。比如 ARKit 依赖于 SceneKit 提供渲染,而 Unity 则自己提供渲染(追踪和识别依然是对 ARKit 和 ARCore 的封装);

- 多人协作与分享:依靠 GPS + 特征点 + 网络等技术,如苹果的MultipeerConnectivity + CollaborativeSession + WorldMap共享,2020年LocationAnchor,以及谷歌的云锚点等,实现多人共享 AR 效果。

能够同时把这些都做好,才是一个很完善的 AR 应用。至少,也要做好这四项中的两项,而不是目前很多只是将原来的 3D 内容简单改为 AR 形式。

考虑到第一项 SLAM 其实是 AR 平台或硬件提供的功能,实际上大部分 AR 应用只要做好后面三项中的两项,就是一个很棒的 AR APP 了。

AR 产品的方向

我心目中对于 AR 产品有几个经典例子:三维建模软件shapr 3D,身体解剖软件Complete Anatomy,和沙雕风格的らくがきAR(RakugakiAR)(即涂鸦 AR)

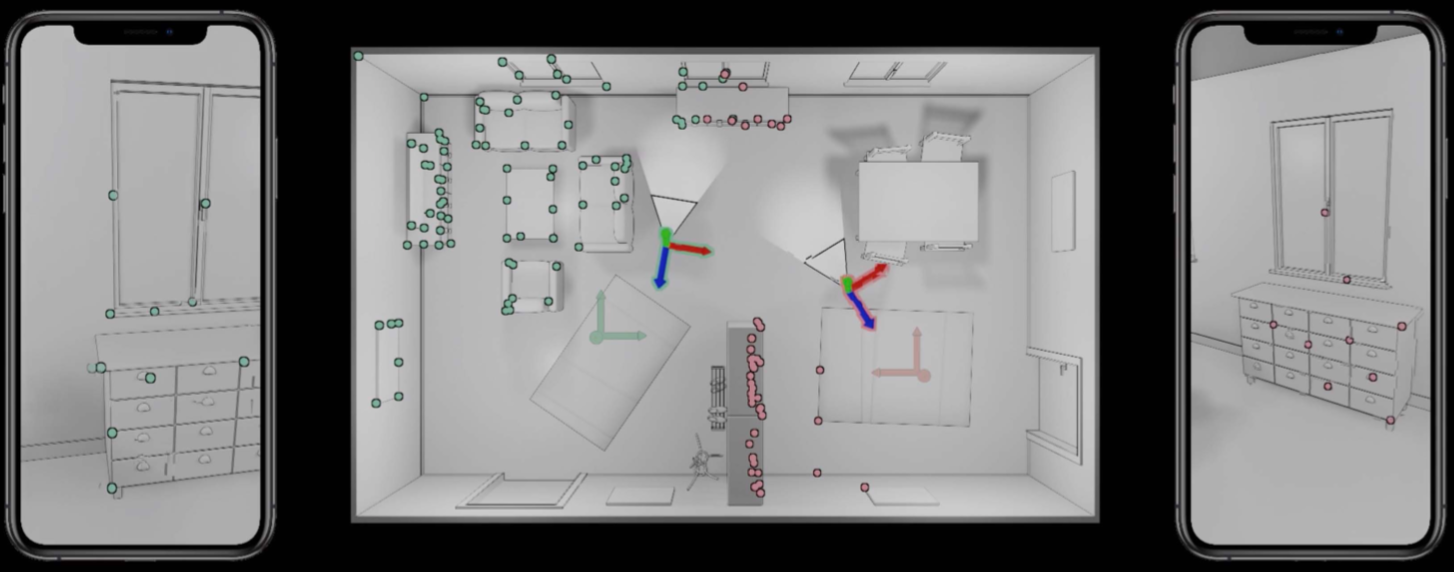

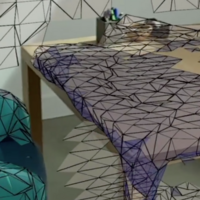

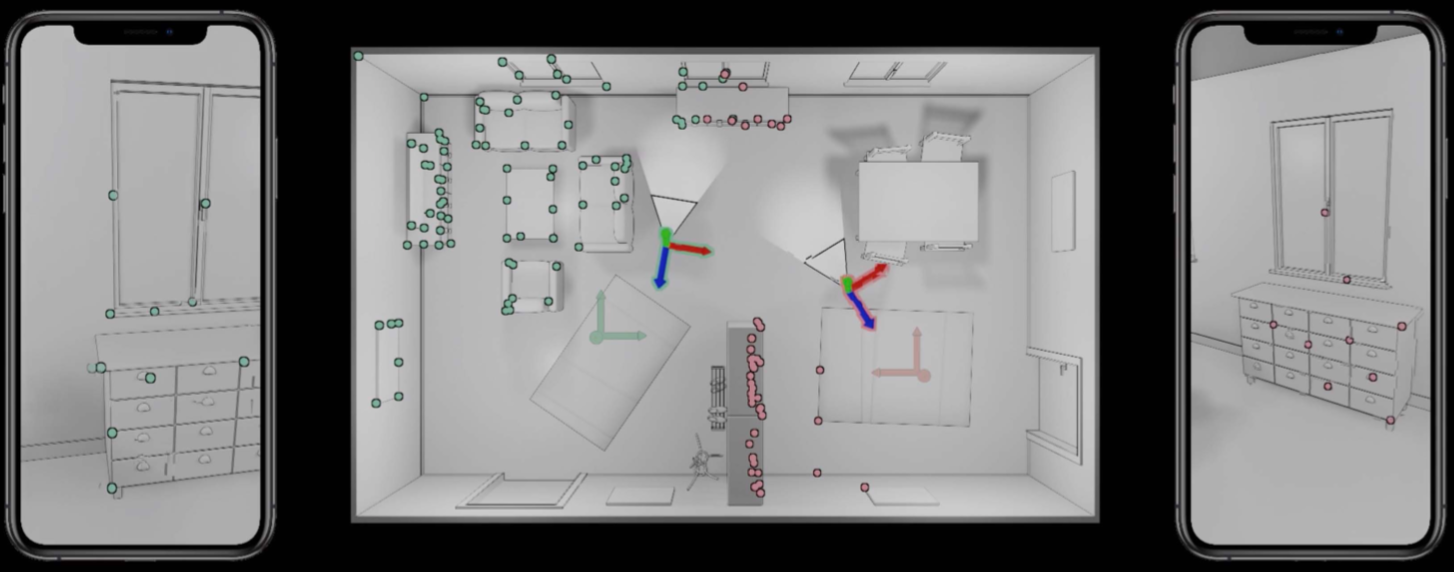

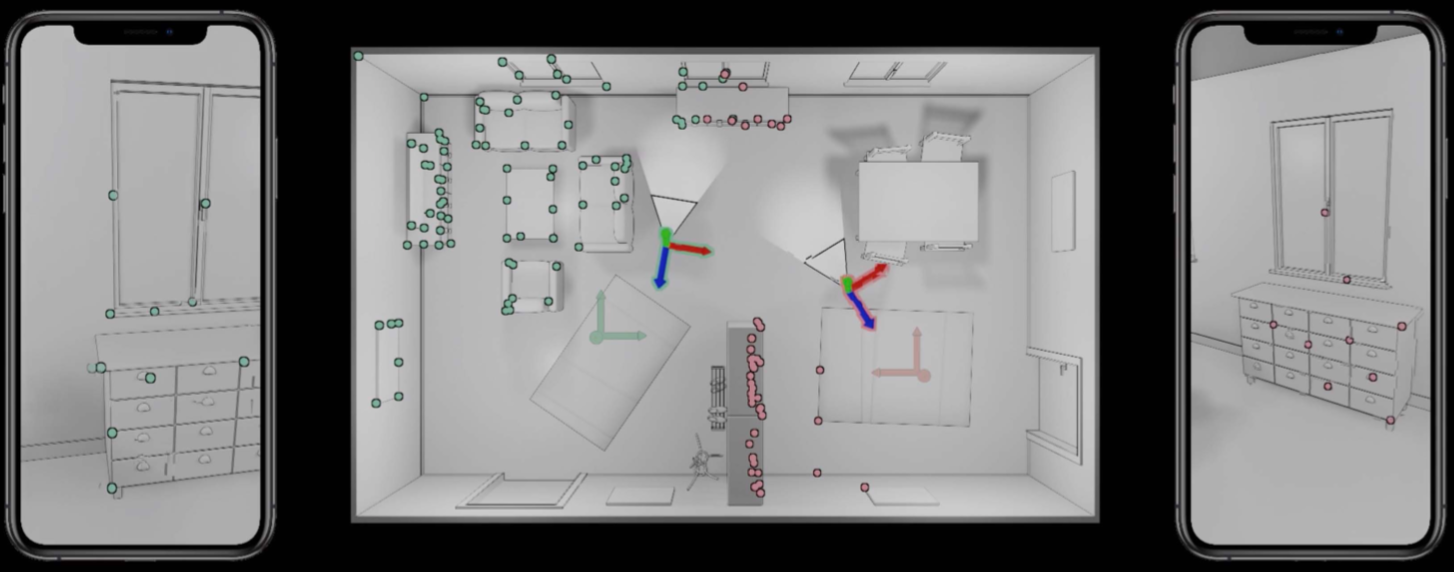

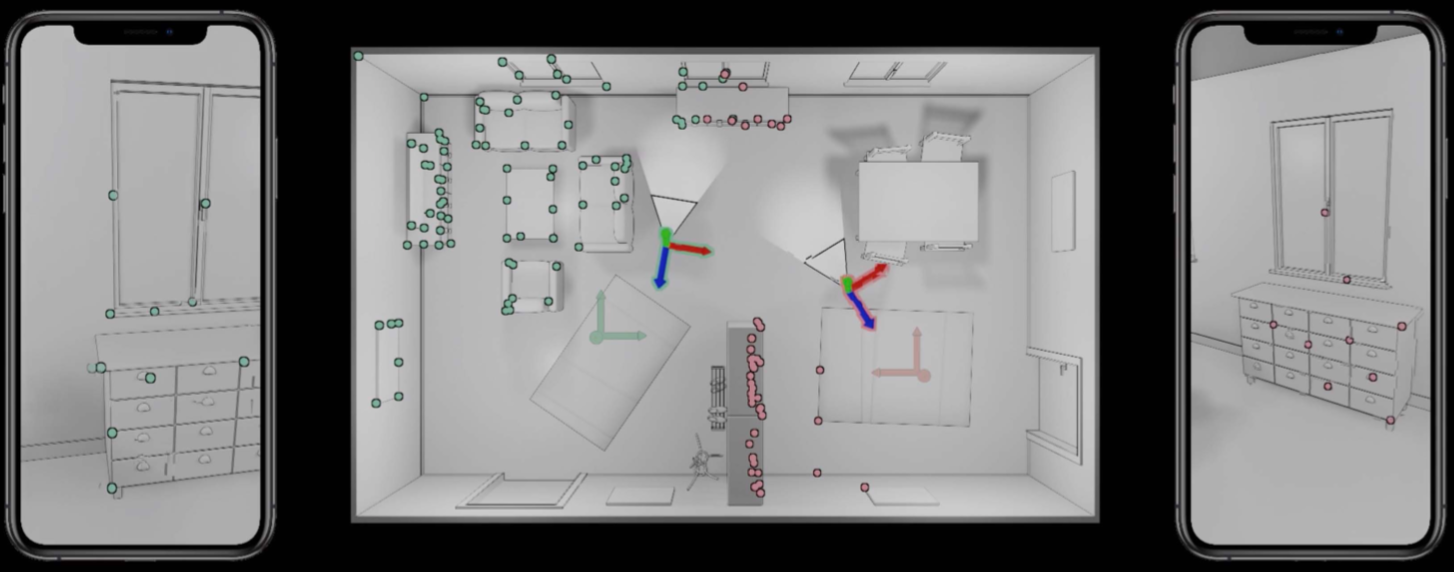

下面是shapr 3D的演示 Demo,直接用 LiDar 扫瞄房间,生成房间和家具的三维图纸,编辑后,再以 AR 方式预览:

身体解剖软件Complete Anatomy则将动作捕捉和人体解剖模型关联起来,让人更清楚看到人体的动作状态:

涂鸦 AR识别平面图形,将其变成 3D 物体,并以 AR 方式展现:

这几个 app 都做到了利用 CV+ML 来识别并提取场景中物体信息,并提供了有创意的或强大的 3D 渲染技术,来展现 AR 效果,这也是它们成功的原因。

当然,也可以类似Pokémon Go那样,依靠 GPS+3D 渲染,来制作多人 LBS 类 app。

“谁是我们的敌人?谁是我们的朋友?这个问题是革命的首要问题。”

反思

做为一个写了很多文章,一直在鼓吹 AR 的AR 神棍,我对 AR 的兴趣开始于 2015 年,那时刚入门 iOS 开发一年左右,正是 AR/VR 又一次火起来的时候,当时苹果也还没有拿出 ARKit,只好先学开发基础知识和 SceneKit。

从 ARKit 推出后,我就利用业余时间不停学习这个框架,并尝试写一些 Demo 和基础文章,学习相关数学基础,整整三年从 ARKit 1 跟着学到了 ARKit 3。

在这四五年里,看到了 AR/VR 行业经历了一个完整的泡沫周期:概念普及 --> 引人瞩目 --> 期望过高骗子横行 --> 热情下降 --> 无人问津。

到 2020 年中,虽然 AR 仍然没有火起来,但我已经在移动 AR 行业完整工作一年了,开发了 10 多个大大小小的 Demo 和几个完整的 AR 产品,对 iOS 平台的 ARKit 比较熟悉,对苹果新推出的 RealityKit 及 Unity 平台的 ARFoundation 也有一定了解。

但是,即使我在 AR 方面付出了这么多努力,有了不少经验,我却从没有认真深入思考过革命的首要问题:AR 到底需要学什么?用 AR 又该做什么?

AR 基本流程

要搞明白这些问题,就必须先来梳理一下 AR 的基本流程:

- 即时定位与地图映射(SimultaneousLocalizationAndMapping,SLAM):依靠 VIO+IMU+CV+TOF 等技术,实现特征点提取,场景重建,平面识别,图片识别等功能;

- 场景感知和识别:依靠 CV 、ML 等技术,识别不同场景和其中的物体,比如 ARKit 已经能够识别桌子、椅子、墙面、天花板、人体等;

- 叠加 3D 图像和声音:依靠 3D 渲染技术,将虚拟的画面和声音,叠加在的场景中或者已识别的物体上。比如 ARKit 依赖于 SceneKit 提供渲染,而 Unity 则自己提供渲染(追踪和识别依然是对 ARKit 和 ARCore 的封装);

- 多人协作与分享:依靠 GPS + 特征点 + 网络等技术,如苹果的MultipeerConnectivity + CollaborativeSession + WorldMap共享,2020年LocationAnchor,以及谷歌的云锚点等,实现多人共享 AR 效果。

能够同时把这些都做好,才是一个很完善的 AR 应用。至少,也要做好这四项中的两项,而不是目前很多只是将原来的 3D 内容简单改为 AR 形式。

考虑到第一项 SLAM 其实是 AR 平台或硬件提供的功能,实际上大部分 AR 应用只要做好后面三项中的两项,就是一个很棒的 AR APP 了。

AR 产品的方向

我心目中对于 AR 产品有几个经典例子:三维建模软件shapr 3D,身体解剖软件Complete Anatomy,和沙雕风格的らくがきAR(RakugakiAR)(即涂鸦 AR)

下面是shapr 3D的演示 Demo,直接用 LiDar 扫瞄房间,生成房间和家具的三维图纸,编辑后,再以 AR 方式预览:

身体解剖软件Complete Anatomy则将动作捕捉和人体解剖模型关联起来,让人更清楚看到人体的动作状态:

涂鸦 AR识别平面图形,将其变成 3D 物体,并以 AR 方式展现:

这几个 app 都做到了利用 CV+ML 来识别并提取场景中物体信息,并提供了有创意的或强大的 3D 渲染技术,来展现 AR 效果,这也是它们成功的原因。

当然,也可以类似Pokémon Go那样,依靠 GPS+3D 渲染,来制作多人 LBS 类 app。

“谁是我们的敌人?谁是我们的朋友?这个问题是革命的首要问题。”

反思

做为一个写了很多文章,一直在鼓吹 AR 的AR 神棍,我对 AR 的兴趣开始于 2015 年,那时刚入门 iOS 开发一年左右,正是 AR/VR 又一次火起来的时候,当时苹果也还没有拿出 ARKit,只好先学开发基础知识和 SceneKit。

从 ARKit 推出后,我就利用业余时间不停学习这个框架,并尝试写一些 Demo 和基础文章,学习相关数学基础,整整三年从 ARKit 1 跟着学到了 ARKit 3。

在这四五年里,看到了 AR/VR 行业经历了一个完整的泡沫周期:概念普及 --> 引人瞩目 --> 期望过高骗子横行 --> 热情下降 --> 无人问津。

到 2020 年中,虽然 AR 仍然没有火起来,但我已经在移动 AR 行业完整工作一年了,开发了 10 多个大大小小的 Demo 和几个完整的 AR 产品,对 iOS 平台的 ARKit 比较熟悉,对苹果新推出的 RealityKit 及 Unity 平台的 ARFoundation 也有一定了解。

但是,即使我在 AR 方面付出了这么多努力,有了不少经验,我却从没有认真深入思考过革命的首要问题:AR 到底需要学什么?用 AR 又该做什么?

AR 基本流程

要搞明白这些问题,就必须先来梳理一下 AR 的基本流程:

- 即时定位与地图映射(SimultaneousLocalizationAndMapping,SLAM):依靠 VIO+IMU+CV+TOF 等技术,实现特征点提取,场景重建,平面识别,图片识别等功能;

- 场景感知和识别:依靠 CV 、ML 等技术,识别不同场景和其中的物体,比如 ARKit 已经能够识别桌子、椅子、墙面、天花板、人体等;

- 叠加 3D 图像和声音:依靠 3D 渲染技术,将虚拟的画面和声音,叠加在的场景中或者已识别的物体上。比如 ARKit 依赖于 SceneKit 提供渲染,而 Unity 则自己提供渲染(追踪和识别依然是对 ARKit 和 ARCore 的封装);

- 多人协作与分享:依靠 GPS + 特征点 + 网络等技术,如苹果的MultipeerConnectivity + CollaborativeSession + WorldMap共享,2020年LocationAnchor,以及谷歌的云锚点等,实现多人共享 AR 效果。

能够同时把这些都做好,才是一个很完善的 AR 应用。至少,也要做好这四项中的两项,而不是目前很多只是将原来的 3D 内容简单改为 AR 形式。

考虑到第一项 SLAM 其实是 AR 平台或硬件提供的功能,实际上大部分 AR 应用只要做好后面三项中的两项,就是一个很棒的 AR APP 了。

AR 产品的方向

我心目中对于 AR 产品有几个经典例子:三维建模软件shapr 3D,身体解剖软件Complete Anatomy,和沙雕风格的らくがきAR(RakugakiAR)(即涂鸦 AR)

下面是shapr 3D的演示 Demo,直接用 LiDar 扫瞄房间,生成房间和家具的三维图纸,编辑后,再以 AR 方式预览:

身体解剖软件Complete Anatomy则将动作捕捉和人体解剖模型关联起来,让人更清楚看到人体的动作状态:

涂鸦 AR识别平面图形,将其变成 3D 物体,并以 AR 方式展现:

这几个 app 都做到了利用 CV+ML 来识别并提取场景中物体信息,并提供了有创意的或强大的 3D 渲染技术,来展现 AR 效果,这也是它们成功的原因。

当然,也可以类似Pokémon Go那样,依靠 GPS+3D 渲染,来制作多人 LBS 类 app。